En CES 2026, los debates en torno a la infraestructura de computación de la IA fueron más allá de las GPU individuales y más potentes. En su lugar, la atención se centró en una cuestión más importante: ¿Qué debe cambiar cuando la IA pase de los modelos virtuales a los sistemas del mundo real?

Para muchas aplicaciones de IA, especialmente las relacionadas con entornos físicos, esta cuestión ya no es teórica. Afecta directamente a cómo se diseñan, despliegan y operan los sistemas a lo largo del tiempo.

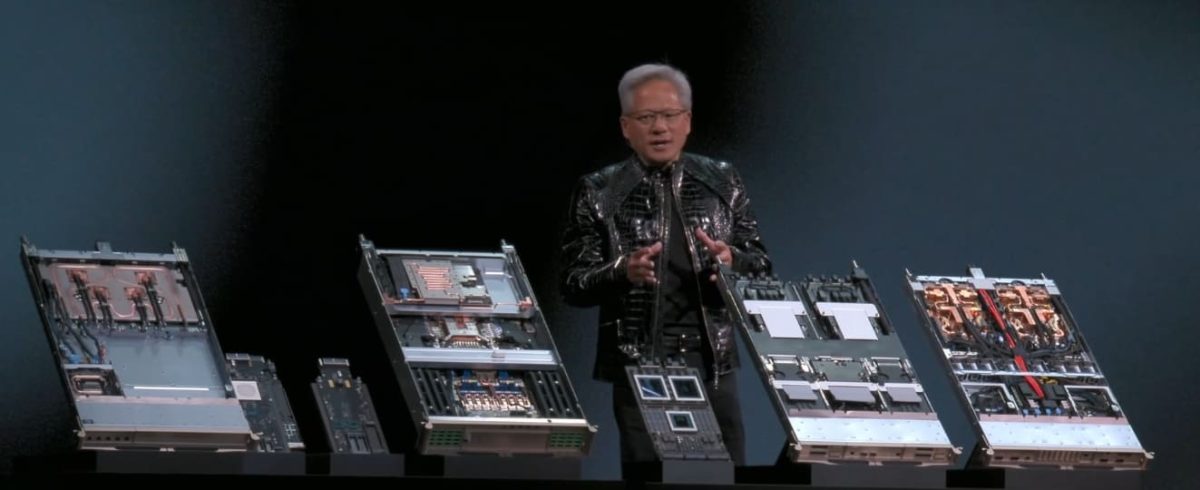

Se debatieron temas como la plataforma Rubin, la formación virtual en IA, la IA física y la conducción autónoma. El mensaje fue claro: la computación de la IA ya no es solo cuestión de hardware más rápido, sino de cómo funciona todo el sistema.

Cuando añadir más computación ya no es suficiente

En los primeros tiempos de la inferencia de IA, mejorar el rendimiento era relativamente sencillo.

Los modelos eran más pequeños, las cargas de trabajo eran estables y, si se añadía más capacidad de cálculo, se obtenían mejores resultados.

A medida que los sistemas de IA se extienden a casos de uso en el mundo real -como automatización industrial, Este enfoque empieza a fallar cuando se trata de infraestructuras inteligentes y despliegues periféricos. La potencia de cálculo sigue siendo importante, pero no siempre se traduce directamente en un mayor rendimiento o un mejor comportamiento del sistema.

La latencia se hace más difícil de controlar, los sistemas funcionan continuamente y el coste de ejecutar la inferencia crece con el tiempo. A estas alturas, el verdadero problema ya no es de cuántos ordenadores dispone, pero la eficacia con la que el sistema lo utiliza.

Los problemas a escala suelen ser problemas del sistema

En las implantaciones reales, los problemas de rendimiento suelen deberse más a la coordinación que al cálculo.

Los datos se mueven entre CPU, GPU y almacenamiento. Varios nodos deben mantenerse sincronizados: los retrasos en la red y la sobrecarga de programación se hacen patentes.

Estos retos son familiares en los grandes sistemas en nube, pero se hacen aún más notables en entornos distribuidos y orientados a los bordes, donde los recursos son limitados y los sistemas deben permanecer estables durante largos periodos.

Las situaciones típicas son:

1)El uso de la GPU parece normal, pero el rendimiento del sistema deja de mejorar.

2)Aumentar el tamaño del lote no ayuda y puede aumentar la latencia

3) Añadir hardware aumenta la complejidad sin reducir el coste global

Son señales de que el propio sistema se ha convertido en el cuello de botella.

De la IA limitada por el ordenador a la IA limitada por el sistema

| Aspecto | Etapa con limitaciones informáticas | Etapa de sistema limitado |

|---|---|---|

| Principal cuello de botella | Informática insuficiente | Espera, coordinación, movimiento de datos |

| Efecto de escala | El rendimiento aumenta con el hardware | Rendimientos decrecientes |

| Utilización de la GPU | Bajo o inestable | Parece alto, pero ineficiente |

| Comportamiento de latencia | Predomina la latencia media | P95 / P99 crecen rápidamente |

| Factor de coste | Rendimiento y precio del hardware | Tiempo de inactividad, potencia, operaciones |

| Enfoque de optimización | Fichas más rápidas | Trayectorias de datos y programación más cortas |

El coste de la inferencia ya no se limita al hardware

Cuando los sistemas llegan a este punto, el coste de la inferencia cambia de naturaleza.

Ya no se trata sólo del precio de la GPU o de su rendimiento bruto. Influyen el tiempo de espera dentro del sistema, la programación ineficiente, el movimiento frecuente de datos y el consumo de energía durante el funcionamiento continuo.

Para sistemas de IA industriales y de vanguardia, Estos factores son especialmente importantes. Los sistemas suelen funcionar 24 horas al día, 7 días a la semana, se despliegan en grandes cantidades y deben operar dentro de unos límites estrictos de potencia y mantenimiento.

Desde un punto de vista práctico, lo caro no suele ser el cálculo en sí, sino todo lo que lo rodea.

Por eso, la infraestructura informática de la IA se trata cada vez más como un problema de ingeniería a nivel de sistema y no como una mejora del hardware.

¿Por qué Rubin se posiciona como plataforma

Por eso Rubin se describe como una plataforma y no sólo como un chip.

La idea es reducir antes las ineficiencias del sistema, en lugar de solucionar los problemas después de que aparezcan.

Al diseñar conjuntamente el hardware, las interconexiones y el software, el objetivo es garantizar que se utilice realmente más tiempo de cálculo para la inferencia, en lugar de perderlo en esperas, coordinación o transferencias de datos. Este tipo de optimización a nivel de sistema es especialmente relevante para la inferencia a gran escala y los despliegues distribuidos.

El entrenamiento virtual de la IA expone los límites más rápidamente

La formación virtual en IA hace más visibles los problemas del sistema.

Los entornos de alta calidad, las simulaciones físicas y las cargas de trabajo paralelas ejercen una fuerte presión sobre la programación y las rutas de datos.

Para los sistemas físicos -incluidos robots, máquinas y equipos autónomos-, la formación virtual ayuda a cubrir escenarios que son difíciles o caros de reproducir en el mundo real. Al mismo tiempo, crea cargas de trabajo exigentes que ponen rápidamente de manifiesto las ineficiencias de la infraestructura informática.

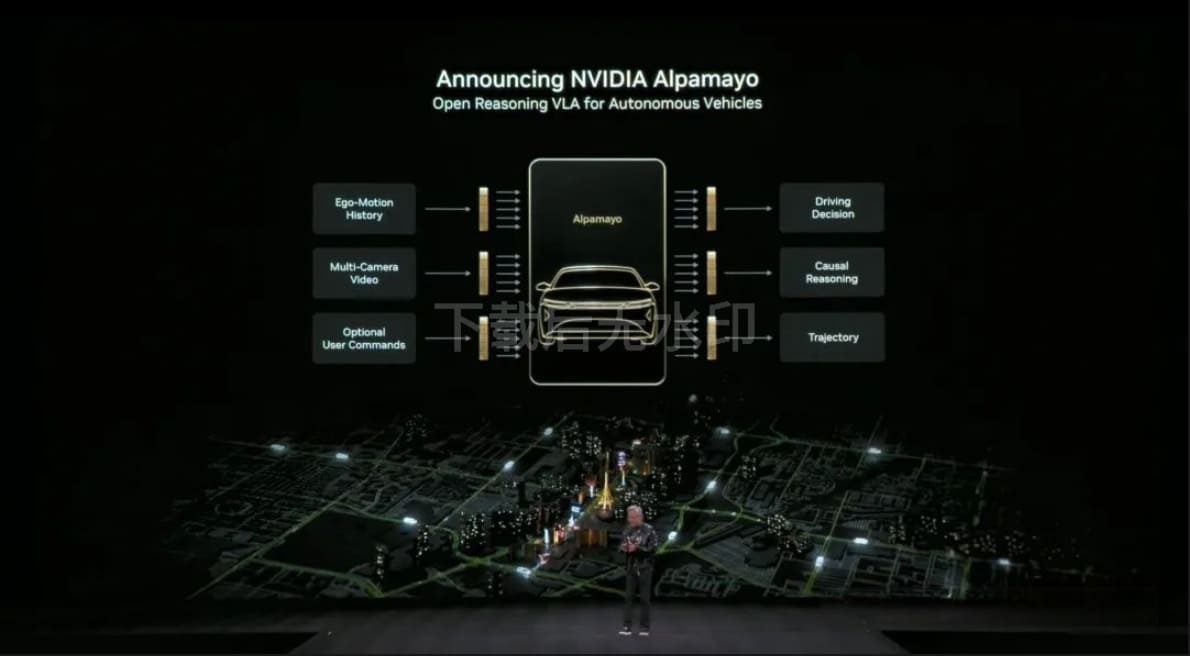

La conducción autónoma lleva los sistemas al límite

La conducción autónoma es uno de los escenarios físicos de IA más exigentes.

Combina múltiples entradas de sensores, entornos en constante cambio y estrictos requisitos de fiabilidad.

Aunque los sistemas de automoción suelen funcionar con hardware especializado, muchos de los mismos retos aparecen también en aplicaciones industriales y edge AI: procesamiento en tiempo real, estabilidad a largo plazo y control estricto de la potencia y el comportamiento del sistema.

Un cambio importante para la IA en el mundo real

Si observamos el mensaje general de CES 2026, una tendencia resulta evidente. La informática de IA está dejando de limitarse a añadir más computación para centrarse en la gestión de la complejidad de los sistemas.

A medida que la IA sigue expandiéndose más allá de los centros de datos, hacia fábricas, infraestructuras y entornos periféricos, la eficiencia del sistema se vuelve más importante que el rendimiento máximo. Reducir la sobrecarga innecesaria, simplificar las rutas de datos y mantener los sistemas estables durante largos periodos serán retos clave.

Puede que esto no afecte a todas las implantaciones actuales. Los sistemas más pequeños pueden seguir confiando en las arquitecturas tradicionales. Pero para la inferencia a gran escala, la IA física y las aplicaciones industriales, los límites a nivel de sistema ya forman parte de la realidad cotidiana de la ingeniería.

Descargo de responsabilidad:

Todas las imágenes utilizadas en este artículo proceden del sitio web oficial de NVIDIA y de material de dominio público. Si tiene algún problema relacionado con los derechos de autor o desea solicitar su eliminación, póngase en contacto con nosotros y lo resolveremos lo antes posible. Este artículo está destinado únicamente a la interpretación técnica y el intercambio de información y no constituye ningún tipo de promoción comercial ni asesoramiento en materia de inversión.